Le vrai débat n’est pas SSD contre HDD, mais comment architecturer un système hybride qui aligne la physique du stockage avec les exigences de vos données.

- Les disques durs classiques (HDD) créent un goulet d’étranglement mécanique, fatal aux bases de données transactionnelles à cause des accès aléatoires.

- Le choix du RAID (RAID 10 > RAID 5 pour les écritures) a souvent plus d’impact sur la performance et la sécurité que le type de disque lui-même.

- L’optimisation des coûts ne réside pas dans le choix du disque le moins cher, mais dans une stratégie de stockage hiérarchisé (tiered storage) et de tests de restauration rigoureux.

Recommandation : Auditez les accès réels à vos données pour créer une hiérarchie de stockage (chaud, tiède, froid) et ne payez que pour la performance dont vous avez besoin, là où vous en avez besoin.

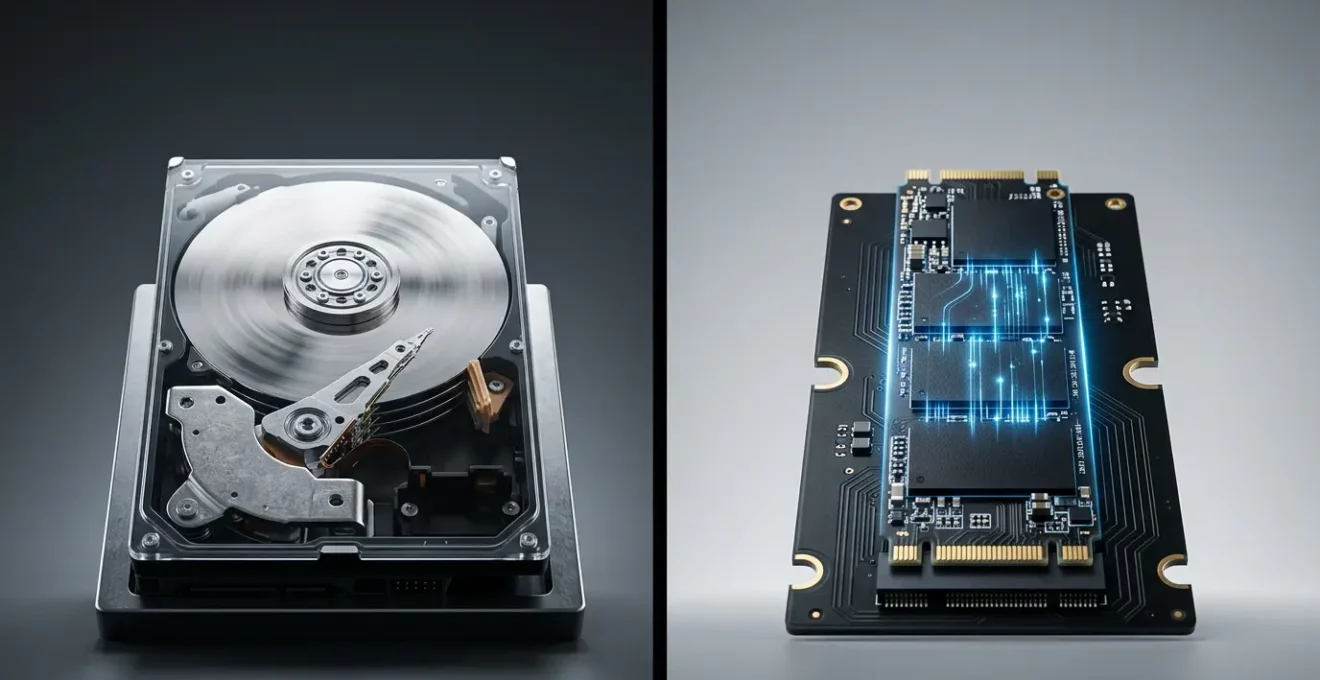

Votre application est lente. Malgré des processeurs de dernière génération et une mémoire RAM abondante, les requêtes vers la base de données semblent s’éterniser, créant une frustration palpable pour les utilisateurs et une migraine pour les équipes techniques. Le premier réflexe est souvent de pointer du doigt le stockage, déclenchant l’éternel débat : faut-il tout miser sur la vitesse brute des SSD ou sur le coût par téraoctet avantageux des HDD ? Cette question, bien que légitime, masque une réalité bien plus complexe et stratégique.

La discussion se résume trop souvent à une simple opposition binaire entre IOPS et budget. On lit partout que les SSD sont indispensables pour les bases de données transactionnelles (OLTP), tandis que les HDD suffisent pour l’archivage. C’est un bon point de départ, mais c’est l’équivalent de dire qu’une voiture de sport est rapide et un camion, spacieux. Pour un ingénieur infrastructure ou un CTO, cette simplification est insuffisante. Elle ignore des facteurs cruciaux comme la pénalité d’écriture inhérente aux différentes configurations RAID, l’impact de la fragmentation des index sur un disque mécanique, ou encore les stratégies de cycle de vie des données dans un environnement cloud.

Mais si la véritable clé n’était pas de choisir un camp, mais de cesser de penser en termes de disques pour raisonner en termes d’architecture ? L’enjeu n’est pas « SSD ou HDD », mais « comment orchestrer intelligemment un écosystème de stockage hybride ». La performance absolue n’a de sens que si elle est appliquée là où elle est nécessaire. Cet article dépasse la simple comparaison matérielle pour vous fournir une grille de lecture d’architecte système. Nous allons décortiquer, couche par couche, les véritables leviers d’optimisation, du comportement physique du disque à la configuration logicielle la plus fine, pour vous permettre de bâtir une infrastructure de base de données qui soit non seulement performante, mais aussi économiquement soutenable et résiliente.

Cet article vous guidera à travers les décisions critiques pour architecturer votre stockage de données. Nous analyserons les compromis fondamentaux, des choix matériels aux stratégies logicielles, pour vous aider à construire un système à la fois rapide, sécurisé et rentable.

Sommaire : Architecturer le stockage de base de données, au-delà du duel SSD vs HDD

- Pourquoi un disque dur classique goulotte d’étranglement de votre application web ?

- RAID 5 ou RAID 10 : quel compromis entre vitesse d’écriture et sécurité des données ?

- Comment déplacer automatiquement les données peu utilisées vers des disques moins chers ?

- L’erreur de ne pas tester ses backups qui transforme un crash disque en faillite

- S3 vs Stockage Bloc : quand utiliser le stockage objet pour vos fichiers médias ?

- Comment indexer vos tables SQL pour accélérer vos recherches de 500% ?

- Problème de rétention : comment configurer le cycle de vie des snapshots pour ne pas payer le stockage inutilement ?

- Comment réduire vos factures AWS/Azure de 40% en optimisant vos instances de bases de données ?

Pourquoi un disque dur classique goulotte d’étranglement de votre application web ?

L’affirmation « les SSD sont plus rapides que les HDD » est une évidence. Mais pour un administrateur système, le « pourquoi » est fondamental, car il révèle la nature même du goulet d’étranglement. Un disque dur classique (HDD) est une merveille d’ingénierie mécanique, mais c’est précisément sa nature mécanique qui le condamne face aux workloads de bases de données. Chaque opération de lecture/écriture aléatoire (I/O) nécessite un déplacement physique de la tête de lecture vers la bonne piste, suivi d’une attente que le plateau rotatif présente le bon secteur. Ce temps de recherche (seek time) et cette latence rotationnelle, bien que minimes, s’accumulent de manière désastreuse.

Pour une base de données transactionnelle où des centaines de petites requêtes concurrentes sollicitent des données éparpillées sur le disque, c’est le scénario catastrophe. La file d’attente des I/O (I/O queue) s’allonge, le processeur attend les données, et l’application ralentit. Un SSD, étant à état solide, n’a pas de pièces mobiles. Il accède à n’importe quelle cellule de mémoire avec une latence quasi constante et infime. Une étude comparative récente démontre que la latence des SSD est de 40 à 100 microsecondes pour les accès aléatoires, contre 5000 à 10000 microsecondes pour les HDD. C’est un facteur de 100. Ce n’est plus une différence de vitesse, c’est un changement de paradigme.

Le goulot d’étranglement mécanique d’un HDD est donc particulièrement pénalisant pour l’indexation B-Tree des bases de données SQL, qui implique de nombreux sauts entre les nœuds de l’index. Alors qu’un HDD peine à dépasser 150-200 IOPS (opérations d’I/O par seconde) en accès aléatoire, un SSD d’entreprise peut en gérer des centaines de milliers. Pour une application web moderne, confier sa base de données principale à un HDD, c’est comme équiper une voiture de Formule 1 avec des roues de charrette : le moteur a beau être puissant, il est bridé par le point de contact avec le sol.

RAID 5 ou RAID 10 : quel compromis entre vitesse d’écriture et sécurité des données ?

Le choix du niveau de RAID est une décision d’architecture aussi critique que le choix du disque. Il est tentant de choisir le RAID 5 pour sa capacité utile supérieure (N-1 disques), le considérant comme un bon compromis. Cependant, pour une base de données transactionnelle, ce choix peut être une grave erreur de performance due à ce qu’on appelle la pénalité d’écriture (write penalty). En RAID 5, chaque opération d’écriture simple se transforme en quatre opérations disque : lire l’ancienne donnée, lire l’ancienne parité, écrire la nouvelle donnée, et écrire la nouvelle parité. Cette pénalité de 4x dégrade considérablement les performances en écriture.

Le RAID 10 (ou RAID 1+0), une combinaison de miroirs (RAID 1) et de striping (RAID 0), n’a qu’une pénalité d’écriture de 2x (chaque écriture est simplement dupliquée sur son miroir). Pour une base de données avec beaucoup d’écritures (commandes, logs, mises à jour de sessions), la différence est spectaculaire. De plus, la sécurité en cas de panne est bien supérieure. Lors de la reconstruction d’un disque défaillant en RAID 5, le contrôleur doit lire tous les autres disques pour recalculer les données manquantes. Sur des HDD de plusieurs téraoctets, ce processus peut prendre des jours, pendant lesquels la grappe est vulnérable à une seconde panne, qui serait fatale.

En RAID 10, la reconstruction n’implique que la copie des données depuis le disque miroir survivant, un processus beaucoup plus rapide et moins risqué. C’est pourquoi le RAID 5 est aujourd’hui fortement déconseillé pour les HDD de grande capacité. Sur SSD, le débat est plus nuancé car les temps de reconstruction sont plus courts, mais la pénalité d’écriture demeure une considération majeure pour la performance et l’endurance des cellules NAND.

Pour arbitrer ce choix, cette analyse comparative est éclairante. Comme le montre une documentation technique de référence sur les serveurs, les implications de chaque configuration sont profondes :

| Critère | RAID 5 | RAID 10 |

|---|---|---|

| Pénalité écriture | 4x (lecture-modification-écriture-parité) | 2x (miroir simple) |

| Temps reconstruction | Plusieurs jours sur HDD multi-To | Quelques heures |

| Risque pendant rebuild | Très élevé (panne second disque = perte totale) | Modéré (panne du miroir seulement) |

| Capacité utile | n-1 disques | n/2 disques |

| Recommandation SSD | Viable pour workloads lecture-intensive | Optimal pour bases transactionnelles |

aesthetic > drama. »/>

Cette visualisation de l’architecture met en évidence la complexité du RAID 5 (à gauche), avec ses calculs de parité distribués, par rapport à la simplicité redondante du RAID 10 (à droite), où les données sont simplement mises en miroir. Pour les bases de données critiques, la simplicité et la robustesse du RAID 10 sont presque toujours le choix le plus sûr et le plus performant, malgré son coût plus élevé en termes de capacité utile.

Comment déplacer automatiquement les données peu utilisées vers des disques moins chers ?

L’idée de placer 100% de ses données sur des SSD NVMe ultra-performants est séduisante, mais économiquement irréaliste pour la plupart des entreprises. La vérité est que toutes les données n’ont pas la même valeur ni la même fréquence d’accès. Une analyse typique d’une base de données révèle qu’une petite fraction des données (les commandes récentes, les profils actifs) est « chaude » et accédée constamment, tandis que la grande majorité est « froide » (archives, logs anciens) et rarement consultée. Payer le prix fort pour stocker des données froides sur des disques rapides est un gaspillage de ressources.

C’est ici qu’intervient le concept de stockage hiérarchisé (tiered storage). La stratégie consiste à identifier dynamiquement la « température » des données et à les migrer automatiquement vers le niveau de stockage approprié. Les données chaudes résident sur des SSD NVMe (Tier 0), les données tièdes sur des SSD SATA (Tier 1), et les données froides sur des HDD capacitifs (Tier 2). Cette approche permet de bénéficier de la performance là où elle est nécessaire, tout en profitant du faible coût par To des HDD pour le stockage de masse.

Mettre en place cette hiérarchie n’est plus une opération manuelle complexe. Les systèmes de stockage modernes et les plateformes cloud (AWS S3 Intelligent-Tiering, Azure Lifecycle Management) proposent des mécanismes automatisés. Selon les données de Google Cloud, un stockage sur HDD coûte 3x moins cher qu’un stockage sur SSD, bien qu’il ne supporte qu’une fraction des opérations de lecture. La clé est d’implémenter une politique de migration basée sur des règles précises : par exemple, toute donnée non accédée depuis 90 jours est automatiquement déplacée du Tier 1 (SSD) au Tier 2 (HDD). Le partitionnement des tables par période (par exemple, une partition par mois) facilite grandement ce processus, permettant de migrer des blocs entiers de données anciennes d’un seul coup.

L’erreur de ne pas tester ses backups qui transforme un crash disque en faillite

Disposer de sauvegardes est une chose. Être certain qu’elles sont restaurables en est une autre. La confiance aveugle dans un script de backup qui s’exécute sans erreur chaque nuit est l’une des erreurs les plus dangereuses en administration système. Un backup peut être corrompu, incomplet, ou la procédure de restauration peut échouer pour une myriade de raisons imprévues. Sans tests réguliers, une sauvegarde n’est qu’une hypothèse de sécurité. Le jour d’un crash disque, cette hypothèse peut se transformer en une faillite si la restauration échoue.

La fiabilité des disques s’est améliorée, mais les pannes restent une réalité statistique inévitable. Les dernières statistiques de Backblaze, un fournisseur de stockage cloud qui monitore des centaines de milliers de disques, révèlent qu’en tant que disques de démarrage, le taux de défaillance annuel est de 0,58% pour les SSD contre 10,56% pour les HDD. Même avec des SSD plus fiables, la question n’est pas *si* un disque tombera en panne, mais *quand*. L’unique assurance est un processus de restauration testé et maîtrisé. Ce test ne doit pas être une opération manuelle et occasionnelle, mais un processus automatisé et intégré à votre infrastructure.

Le but est de valider en permanence vos objectifs de temps de restauration (RTO) et de point de restauration (RPO). Un test de restauration automatisé simule un scénario de catastrophe complet dans un environnement isolé, sans jamais impacter la production. Il vérifie non seulement que les données sont physiquement présentes, mais aussi qu’elles sont cohérentes et que l’application peut redémarrer en s’appuyant sur elles. Ce n’est qu’en transformant la restauration en une routine prévisible et mesurable que l’on peut véritablement garantir la continuité d’activité.

Votre plan d’action pour des restaurations à l’épreuve des pannes

- Créer un script nocturne d’instanciation de serveur temporaire via Docker ou une VM pour isoler le test.

- Restaurer automatiquement le dernier snapshot ou backup de la base de données sur cette instance de test.

- Exécuter un jeu de requêtes de validation (ex: SELECT COUNT(*), requêtes métier critiques) pour vérifier la cohérence fonctionnelle des données.

- Vérifier l’intégrité structurelle via des checksums sur les tables clés et un comptage précis des enregistrements attendus.

- Générer un rapport automatique envoyé par email ou sur Slack, avec les métriques de RTO et RPO réels mesurés durant le test.

S3 vs Stockage Bloc : quand utiliser le stockage objet pour vos fichiers médias ?

Une erreur d’architecture courante consiste à tout stocker dans la base de données, y compris les fichiers binaires volumineux comme les images, les vidéos ou les documents PDF. Si cela peut sembler simple au premier abord, cette approche est un anti-pattern qui conduit à des bases de données obèses, des sauvegardes interminables et des performances dégradées. La base de données est optimisée pour gérer des données structurées et des transactions, pas pour servir de système de fichiers. Le stockage de fichiers volumineux (BLOBs) augmente drastiquement la taille des tables, ralentit les requêtes et complique la maintenance.

La solution d’architecture correcte est de séparer les métadonnées des données brutes. La base de données (sur un stockage bloc performant, type SSD) ne stocke que les métadonnées : l’URL du fichier, les permissions d’accès, les descriptions, etc. Les fichiers eux-mêmes sont hébergés sur un système de stockage objet, comme Amazon S3, Google Cloud Storage ou un équivalent on-premise. Le stockage objet est conçu pour une durabilité extrême, une scalabilité quasi infinie et un coût par Go très bas. Il est accessible via une simple API HTTP, ce qui le rend parfaitement adapté à la distribution de contenu web.

Cette dissociation offre une flexibilité immense. Elle permet de servir les fichiers médias via un réseau de diffusion de contenu (CDN) pour une performance globale optimale, tout en gardant la base de données légère, rapide et facile à sauvegarder. Le stockage objet est le pilier des architectures cloud-natives pour une bonne raison : il découple le sort des fichiers de celui de la base de données.

Étude de Cas : L’architecture de stockage de YouTube

L’architecture de YouTube est un exemple emblématique de cette séparation. L’idée fondamentale est de ne stocker que le strict nécessaire dans la base de données (MySQL, puis Vitess). Les métadonnées de la vidéo (titre, description, nombre de vues, commentaires) sont dans la base, mais les fichiers vidéo eux-mêmes ne le sont pas. Seule l’adresse (URL) de la vidéo, qui pointe vers les serveurs de fichiers distribués (CDN et systèmes de stockage internes), est conservée en base de données. Cette approche permet à YouTube de gérer des milliards de vidéos et des requêtes à très haute fréquence sur les métadonnées, sans que la base ne soit paralysée par le poids des fichiers vidéo.

symbolism > beauty. »/>

Ce schéma illustre la séparation claire : à droite, le stockage bloc, structuré et rigide, idéal pour les tables de la base de données ; à gauche, le stockage objet, flexible et scalable, parfait pour les fichiers médias non structurés. Comprendre cette distinction est essentiel pour concevoir des applications scalables et performantes.

Comment indexer vos tables SQL pour accélérer vos recherches de 500% ?

L’indexation est le levier le plus puissant pour accélérer les requêtes en lecture dans une base de données SQL. Un index agit comme l’index d’un livre : au lieu de parcourir toutes les pages (un « full table scan ») pour trouver une information, la base de données consulte l’index pour localiser directement les lignes correspondantes. Une requête qui prend plusieurs secondes sur une table non indexée peut s’exécuter en quelques millisecondes avec le bon index. Cependant, la stratégie d’indexation ne peut ignorer la nature du stockage sous-jacent.

Sur un HDD, chaque index supplémentaire ajoute une pénalité lors des opérations d’écriture (INSERT, UPDATE, DELETE), car la base de données doit mettre à jour non seulement la table, mais aussi chaque index concerné. Compte tenu de la lenteur des accès aléatoires sur un disque mécanique, un nombre excessif d’index peut ralentir considérablement les écritures. La stratégie sur HDD est donc un compromis : créer les index les plus essentiels tout en limitant leur nombre pour ne pas pénaliser les écritures.

Sur un SSD, la donne change. La pénalité d’écriture est beaucoup moins perceptible grâce aux IOPS élevés. Cela ouvre la voie à des stratégies d’indexation plus agressives, comme les index couvrants (covering indexes). Un index couvrant inclut toutes les colonnes nécessaires pour répondre à une requête spécifique. Ainsi, la base de données peut satisfaire la requête en lisant uniquement l’index, sans même avoir besoin d’accéder à la table elle-même. C’est une optimisation extrêmement puissante, rendue possible par la vitesse des SSD. Les derniers benchmarks 2025 montrent que les SSD PCIe 5.0 atteignent 14 500 Mo/s en lecture séquentielle, contre à peine 125 Mo/s pour les HDD. Cette bande passante massive rend les lectures d’index quasi instantanées.

Une bonne stratégie d’indexation consiste à :

- Utiliser l’outil

EXPLAIN(ou équivalent) de votre SGBD pour identifier les requêtes lentes qui effectuent des « full table scans ». - Créer des index sur les colonnes utilisées dans les clauses

WHERE,JOIN, etORDER BY. - Sur SSD, envisager des index couvrants pour les requêtes les plus fréquentes et critiques.

- Monitorer régulièrement l’utilisation des index pour supprimer ceux qui ne sont jamais utilisés et qui ne font que consommer de l’espace et ralentir les écritures.

Problème de rétention : comment configurer le cycle de vie des snapshots pour ne pas payer le stockage inutilement ?

Les snapshots de volumes ou de bases de données sont un outil indispensable pour la sauvegarde et la reprise après sinistre dans les environnements cloud. Ils permettent de capturer l’état d’un disque à un instant T de manière quasi instantanée. La tentation est grande d’en créer fréquemment (toutes les heures, tous les jours) pour minimiser la perte de données (RPO). Cependant, sans une stratégie de rétention claire, ces snapshots s’accumulent rapidement, entraînant une explosion silencieuse des coûts de stockage.

Chaque snapshot, même s’il est incrémentiel (ne stockant que les changements depuis le précédent), consomme de l’espace. Conserver des centaines de snapshots journaliers sur plusieurs mois représente un coût significatif et souvent inutile. La plupart des besoins de restauration concernent des données très récentes (la veille, la semaine passée). Personne n’a besoin de restaurer l’état exact d’une base de données d’il y a 173 jours à 14h30.

La solution est de mettre en place une politique de cycle de vie des snapshots, souvent appelée « Grandfather-Father-Son ». Cette stratégie consiste à diminuer la granularité des sauvegardes à mesure qu’elles vieillissent. Un plan de rétention typique et efficace pourrait ressembler à ceci :

- Fils (quotidien) : Conserver les snapshots journaliers pour les 7 derniers jours, offrant une granularité fine pour les restaurations récentes.

- Père (hebdomadaire) : Après 7 jours, ne conserver qu’un seul snapshot par semaine (par exemple, celui du dimanche) pour les 4 semaines suivantes.

- Grand-père (mensuel) : Après un mois, ne garder qu’un seul snapshot par mois pour les 6 à 12 mois suivants, pour les besoins d’archivage à long terme.

Cette approche pyramidale permet de répondre à la majorité des besoins de restauration tout en réduisant drastiquement le volume de stockage utilisé. La plupart des plateformes cloud (AWS Data Lifecycle Manager, Azure Backup Policies) permettent d’automatiser entièrement ce processus, en définissant des règles pour la création, la rétention et la suppression des snapshots.

À retenir

- La performance d’une base de données ne dépend pas seulement de la vitesse du disque (SSD vs HDD), mais de l’adéquation de l’architecture de stockage (RAID, hiérarchisation) avec la nature des accès aux données.

- Le choix du niveau de RAID est un arbitrage de performance et de sécurité : pour les bases de données transactionnelles, le RAID 10 est presque toujours supérieur au RAID 5 en raison de sa faible pénalité d’écriture et de sa reconstruction plus sûre.

- L’optimisation des coûts dans le cloud passe par des stratégies actives comme le stockage hiérarchisé (tiered storage) et le « right-sizing » des instances, basés sur l’analyse des métriques réelles d’utilisation.

Comment réduire vos factures AWS/Azure de 40% en optimisant vos instances de bases de données ?

Dans le cloud, le coût du stockage n’est qu’une partie de l’équation. La facture globale est souvent dominée par le coût de l’instance de base de données elle-même (CPU, RAM) et les IOPS provisionnés (Provisioned IOPS sur AWS, par exemple). Une erreur fréquente est le surdimensionnement : par peur de la panne ou du ralentissement, on alloue une instance beaucoup plus puissante et plus de IOPS que nécessaire, « au cas où ». Cette « assurance » se paie cher chaque mois.

La méthode la plus efficace pour réduire ces coûts est le « right-sizing », ou le dimensionnement juste. Il ne s’agit pas de deviner, mais d’utiliser les outils de monitoring fournis par le cloud provider (CloudWatch pour AWS, Azure Monitor) pour prendre des décisions basées sur des données réelles. L’objectif est d’analyser les métriques de performance sur une période représentative (2 à 4 semaines) pour comprendre l’utilisation réelle de l’instance.

Les métriques clés à surveiller sont :

- CPUUtilization : Si le pic d’utilisation du CPU ne dépasse jamais 30%, votre instance est probablement surdimensionnée.

- DiskReadOps/DiskWriteOps (IOPS) : Analysez le pic réel d’opérations disque. Si vous payez pour 10 000 IOPS provisionnés et que votre pic n’atteint jamais 4 000, vous gaspillez de l’argent.

- VolumeQueueLength (Longueur de la file d’attente du volume) : Une valeur constamment supérieure à 1 indique que le stockage n’arrive pas à suivre et que vous avez besoin de plus d’IOPS. Une valeur constamment à 0 signifie que vous avez probablement trop d’IOPS.

- Burst Balance (pour les volumes gp2/gp3 sur AWS) : Une balance qui s’épuise régulièrement indique que vous êtes limité par le bursting et que vous devriez envisager un volume avec plus d’IOPS de base.

Sur la base de cette analyse, vous pouvez dimensionner votre instance et vos IOPS au plus juste : prenez le pic réel observé et ajoutez une marge de sécurité de 20-30%. Cette approche itérative, répétée tous les trimestres, permet de réaliser des économies substantielles, souvent de l’ordre de 30 à 40%, sans jamais compromettre la performance.

L’étape suivante consiste à appliquer cette grille d’analyse à votre propre infrastructure. Auditez vos métriques, profilez vos accès et commencez dès aujourd’hui à concevoir une architecture de stockage qui ne sacrifie ni la performance, ni votre budget.