Formation base de données

Les bases de données constituent aujourd’hui le système nerveux central de toute organisation. Qu’il s’agisse de stocker les informations clients d’une PME, d’alimenter les algorithmes de prédiction d’un service marketing ou de garantir la conformité réglementaire d’une entreprise, la maîtrise des données est devenue une compétence stratégique incontournable.

Pourtant, force est de constater que de nombreux professionnels manipulent quotidiennement des bases de données sans disposer des fondamentaux nécessaires. Le résultat ? Des requêtes SQL qui ralentissent les applications, des failles de sécurité exploitées par les cybercriminels, des factures cloud qui explosent sans raison apparente, ou encore des violations du RGPD passibles de sanctions financières lourdes.

Cette ressource vous accompagne dans la compréhension des piliers essentiels d’une formation base de données complète : de la sécurisation des informations sensibles à l’optimisation des performances, en passant par la conformité légale et l’analyse décisionnelle. Chaque section aborde un domaine de compétence distinct, avec des applications concrètes pour votre quotidien professionnel.

Sécurité des données : protéger le patrimoine numérique de l’entreprise

Imaginez votre base de données comme un coffre-fort contenant l’ensemble des informations stratégiques de votre organisation. Une formation solide commence invariablement par la compréhension des menaces et des mécanismes de protection.

Les vecteurs d’attaque les plus courants

Les statistiques sont éloquentes : la grande majorité des incidents de sécurité trouvent leur origine dans des erreurs humaines. Un email de phishing ouvert par un collaborateur, un mot de passe partagé entre plusieurs services, ou une connexion non sécurisée en télétravail suffisent à compromettre des années de travail.

Les ransomwares représentent actuellement la menace la plus redoutée. Ces logiciels malveillants chiffrent l’intégralité de vos données et exigent une rançon pour leur restitution. Sans stratégie de sauvegarde éprouvée, de nombreuses entreprises se retrouvent face à un dilemme impossible.

Les mesures de protection indispensables

Une politique de sécurité efficace repose sur plusieurs couches de défense complémentaires :

- L’authentification à double facteur pour tous les accès sensibles

- La configuration de VPN pour les connexions distantes

- Une stratégie de sauvegarde combinant stockage cloud et physique

- La formation continue des équipes aux bonnes pratiques

- L’application du principe de moindre privilège pour les droits d’accès

Ces mesures ne nécessitent pas forcément des budgets conséquents, mais exigent une méthodologie rigoureuse et une vigilance constante.

Conformité RGPD : maîtriser les obligations légales

La réglementation européenne sur la protection des données personnelles a transformé la gestion des bases de données en enjeu juridique majeur. Une formation complète ne peut ignorer ces aspects réglementaires.

Anonymisation et pseudonymisation

Contrairement aux idées reçues, remplacer les noms par des identifiants génériques ne suffit pas à anonymiser une base. Les techniques de réidentification permettent souvent de retrouver les personnes concernées en croisant plusieurs champs. Une véritable anonymisation nécessite des méthodes statistiques avancées comme le k-anonymat ou la confidentialité différentielle.

Gestion du cycle de vie des données

Le RGPD impose de ne conserver les données personnelles que pour la durée strictement nécessaire à leur finalité. Cette obligation implique de :

- Définir des durées de rétention pour chaque type de donnée

- Mettre en place des mécanismes de suppression automatique

- Gérer les demandes de droit à l’oubli, y compris dans les sauvegardes

- Documenter la preuve du consentement pour les traitements concernés

Les délais de déclaration en cas de fuite de données sont particulièrement stricts : 72 heures pour notifier l’autorité de contrôle compétente.

Performance SQL et optimisation des requêtes

Une base de données peut contenir des millions d’enregistrements parfaitement organisés et pourtant s’avérer inutilisable si les requêtes prennent plusieurs minutes à s’exécuter. L’optimisation des performances constitue une compétence technique fondamentale.

L’art subtil de l’indexation

Les index fonctionnent comme la table des matières d’un livre : ils permettent de localiser rapidement une information sans parcourir l’ensemble des pages. Cependant, créer des index sur toutes les colonnes serait contre-productif. Chaque index accélère les lectures mais ralentit les écritures, car le système doit maintenir la structure à jour lors de chaque insertion ou modification.

La clé réside dans l’analyse des requêtes les plus fréquentes pour indexer uniquement les colonnes pertinentes.

Normalisation et dénormalisation

Les formes normales permettent d’éliminer la redondance des données et de garantir leur intégrité. Toutefois, une normalisation excessive multiplie les jointures nécessaires pour reconstituer l’information, ce qui peut dégrader les performances analytiques.

Le modèle dimensionnel, utilisé dans les entrepôts de données, adopte volontairement une approche dénormalisée pour accélérer les requêtes de reporting. Le choix entre PostgreSQL pour les données structurées et MongoDB pour les données non structurées illustre ces arbitrages architecturaux.

Systèmes de cache

Pour soulager la base principale lors de pics de charge, des solutions comme Redis ou Memcached stockent en mémoire les résultats des requêtes les plus fréquentes. Cette couche intermédiaire peut réduire la latence de plusieurs ordres de grandeur.

Maîtrise des coûts cloud et infrastructure

La migration vers le cloud a démocratisé l’accès aux technologies de bases de données managées, mais génère parfois des factures surprenantes. Comprendre les modèles de tarification devient une compétence à part entière.

Les pièges tarifaires courants

Plusieurs facteurs contribuent à l’explosion des coûts :

- Les données sortantes facturées sans visibilité claire

- Les snapshots de sauvegarde conservés indéfiniment

- Les instances surdimensionnées par rapport aux besoins réels

- Les services propriétaires créant une dépendance au fournisseur

Une analyse régulière de la consommation permet d’identifier des économies pouvant atteindre 30 à 40% de la facture initiale.

Architectures alternatives

Les bases de données serverless proposent un modèle de facturation à l’usage réel : vous ne payez que pour les requêtes exécutées. Cette approche convient particulièrement aux applications avec des charges de travail variables. La migration d’un serveur physique vers un service managé comme RDS nécessite cependant une planification minutieuse pour éviter toute perte de données.

Analyse de données et aide à la décision

Une base de données ne prend sa pleine valeur que lorsque les informations qu’elle contient se transforment en insights actionnables. Cette dimension analytique complète la formation technique.

De l’extraction à la visualisation

Le parcours analytique commence souvent par un constat frustrant : une part importante du temps est consacrée au nettoyage des données plutôt qu’à leur analyse. Des fichiers Excel mal structurés, des cellules masquées faussant les calculs, ou des bases clients incohérentes entre services constituent des obstacles récurrents.

Les outils de visualisation comme Tableau ou PowerBI permettent de présenter des informations complexes de manière accessible. Le choix entre ces solutions dépend notamment de l’écosystème logiciel déjà en place dans l’organisation.

Modélisation prédictive

Les techniques de régression linéaire ou de forêts aléatoires permettent d’anticiper des tendances à partir de données historiques. Toutefois, une erreur classique consiste à confondre corrélation et causalité : deux variables peuvent évoluer ensemble sans que l’une soit la cause de l’autre.

La transition vers des scripts Python devient nécessaire lorsque les macros VBA atteignent leurs limites en termes de volume ou de complexité.

Architecture et qualité des données

L’efficacité d’un système d’information repose sur des fondations architecturales solides et une attention constante à la qualité des données entrantes.

Data Warehouse ou Data Lake ?

Ces deux approches répondent à des besoins distincts. Le Data Warehouse organise les données selon un schéma prédéfini, optimisé pour le reporting. Le Data Lake stocke les données brutes dans leur format d’origine, offrant plus de flexibilité pour les analyses exploratoires. Pour une PME en croissance, le choix dépend de la maturité analytique et des cas d’usage prioritaires.

Le principe Garbage In, Garbage Out

Aucun algorithme sophistiqué ne peut compenser des données de mauvaise qualité. Les processus d’import automatisés doivent intégrer des contrôles de validation dès l’entrée dans le système. Dans les CRM, la gestion des doublons et la complétude des champs obligatoires représentent des défis quotidiens qui impactent directement l’efficacité commerciale.

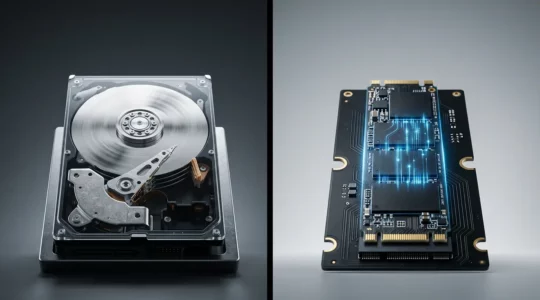

Stockage physique et sauvegardes

Le choix entre SSD et HDD affecte directement les performances applicatives. Les configurations RAID offrent différents compromis entre vitesse et résilience. Mais la règle d’or reste invariable : une sauvegarde non testée n’est pas une sauvegarde. Trop d’organisations découvrent l’impossibilité de restaurer leurs données au moment où elles en ont le plus besoin.

La formation aux bases de données couvre ainsi un spectre remarquablement large, de la technique pure aux enjeux stratégiques. Chaque domaine mérite un approfondissement selon vos responsabilités et vos objectifs professionnels. Les articles détaillés de cette section vous permettront d’explorer chaque thématique avec la profondeur nécessaire à une mise en pratique immédiate.

Stockage de données : SSD ou HDD pour vos serveurs de base de données ?

Le vrai débat n’est pas SSD contre HDD, mais comment architecturer un système hybride qui aligne la physique du stockage avec les exigences de vos données. Les disques durs classiques (HDD) créent un goulet d’étranglement mécanique, fatal aux bases de…

Lire la suite

CRM Sale : Comment nettoyer 10 000 contacts doublons sans perdre l’historique client ?

En résumé : Comprendre la « friction de saisie » pour traiter la cause de la pollution des données, pas seulement les symptômes. Utiliser une méthode de fusion sécurisée qui privilégie la sauvegarde et la concaténation de l’historique client (notes, activités). Automatiser…

Lire la suite

Data Warehouse ou Data Lake : quelle architecture pour une PME en croissance ?

Le débat stérile « Data Warehouse ou Data Lake » paralyse les PME. La solution est une trajectoire évolutive qui sécurise des gains rapides tout en préparant l’avenir. Commencez par un « noyau analytique » structuré (type mini-Warehouse) pour répondre aux besoins urgents de…

Lire la suite

RGPD et Bases de données : Comment anonymiser vos environnements de test sans casser le code ?

Penser qu’anonymiser une base de données se résume à remplacer des noms est la première porte ouverte à une sanction de la CNIL. La réidentification par croisement de données même « anonymisées » est un risque tangible, démontré par de multiples cas…

Lire la suite

Gestion de BDD : Comment réduire la latence de vos requêtes SQL de 50% ?

Contrairement à l’idée reçue, l’optimisation SQL ne se résume pas à ajouter des index. C’est un art du compromis où chaque gain de performance en lecture peut coûter cher en écriture. L’indexation massive ralentit les opérations `INSERT`, `UPDATE` et `DELETE`,…

Lire la suite

Comment réduire vos factures AWS/Azure de 40% en optimisant vos instances de bases de données ?

Penser que le « rightsizing » est la clé pour réduire les coûts de vos bases de données cloud est une erreur qui vous coûte cher. La véritable optimisation réside ailleurs. Les gisements d’économies les plus importants se trouvent dans les coûts…

Lire la suite

Comment prédire vos ventes du mois prochain avec 90% de précision grâce à vos données historiques ?

Atteindre 90% de précision dans la prévision des ventes n’est pas une question d’outils complexes, mais une discipline qui transforme la « dette de données » en un actif de pilotage stratégique. Le principal obstacle n’est pas technique, mais la qualité des…

Lire la suite

Comment protéger les données clients de votre PME contre les ransomwares avec un budget limité ?

En résumé : La cybersécurité des PME ne dépend pas d’un budget colossal, mais de l’application de réflexes pragmatiques sur des points de rupture bien identifiés. La plus grande menace n’est pas technique, mais humaine. Former vos équipes au phishing…

Lire la suite

Comment créer un tableau de bord automatisé qui vous fait gagner 4h de reporting par semaine ?

Le secret d’un reporting automatisé performant n’est pas l’outil que vous choisissez, mais la discipline que vous imposez à vos données sources. Les données « sales » et mal structurées sont la cause n°1 de l’échec des projets de Business Intelligence. La…

Lire la suite

Les avantages de se faire accompagner par le village de l’emploi

Vous venez d’avoir votre diplôme et vous recherchez un emploi dans l’informatique ou autre domaine ? Vous pouvez vous tourner vers le Village de l’Emploi. En fait, grâce à cette plateforme, vous aurez tous les atouts essentiels pour convaincre le…

Lire la suite